A2UIとは?AIエージェント向けUI標準化プロジェクトを徹底解説

結論:A2UIは「AIエージェントの動きを直感的に理解できるUI」を標準化するプロジェクトです

A2UI は、AIエージェントが生成するリッチなインターフェースを、人間が安全に・直感的に操作・理解できるようにするための共通プロトコルです。

エージェントの動きがブラックボックスになりがちな現代のAI開発において、UI を標準化することで開発効率とユーザー体験が大幅に向上します。

この記事でわかること

- A2UI の概要と目的

- A2UI の主要機能

- 従来の UI との違い

- A2UI が向いている人・使いどころ

- 公式 GitHub リンクによる一次情報の確認方法

A2UIとは何か

A2UI(Agent-to-User Interface)は、AIエージェントが UI を生成できる標準仕様です。

テキストだけでなく、構造化された UI を JSON で表現し、エージェントからクライアントへ送信してレンダリングします。これにより、AI と人間のインタラクションが自然になります。

▶ 公式サイト(一次情報)

https://a2ui.org/

▶ GitHub(一次情報)

https://github.com/google/a2ui

なぜ A2UI が必要なのか

AI エージェントは高度になるほど、

- 内部処理が見えづらい

- ログを追わないと理解できない

- UI が統一されていない

という課題があります。

A2UI はこれらを解決するため、

- UI を 宣言的なデータ形式(JSON)として表現

- 安全性を保ちながら意味のある UI を生成

- 複数クライアントで同一の UI を再現可能

という仕組みを提供しています。

A2UI でできること

1. エージェントの状態・UI を可視化する

A2UI では、エージェントの状態を UI として示し、ユーザーが自然に操作できます。

これは従来のログ中心の管理画面とは異なり、動的でインタラクティブな UI として表示されます。

2. 複数プラットフォーム対応

エージェントが送信した JSON 仕様は、クライアント側で任意の UI フレームワークに変換できます。

React、Flutter、Angular、ネイティブアプリといった多様な環境に対応可能です。

3. 安全性を保ちながら UI を生成

A2UI はエージェントがコードを直接実行するのではなく、安全な宣言的 UI を送信する仕組みです。

これにより UI インジェクションなどのリスクを低減できます。

従来の UI と何が違うか

比較項目 | 従来の UI | A2UI |

|---|---|---|

主役 | 人間の操作 | AI エージェント |

UI 表現 | 静的・コード中心 | 宣言的・データ中心 |

安全性 | 可変コード実行あり | 安全なデータ表現 |

拡張性 | 低 | 高 |

従来は人が書いた UI で AI を囲い込む設計ですが、

A2UI は AI 自身が UI を生成できる標準仕様として機能します。

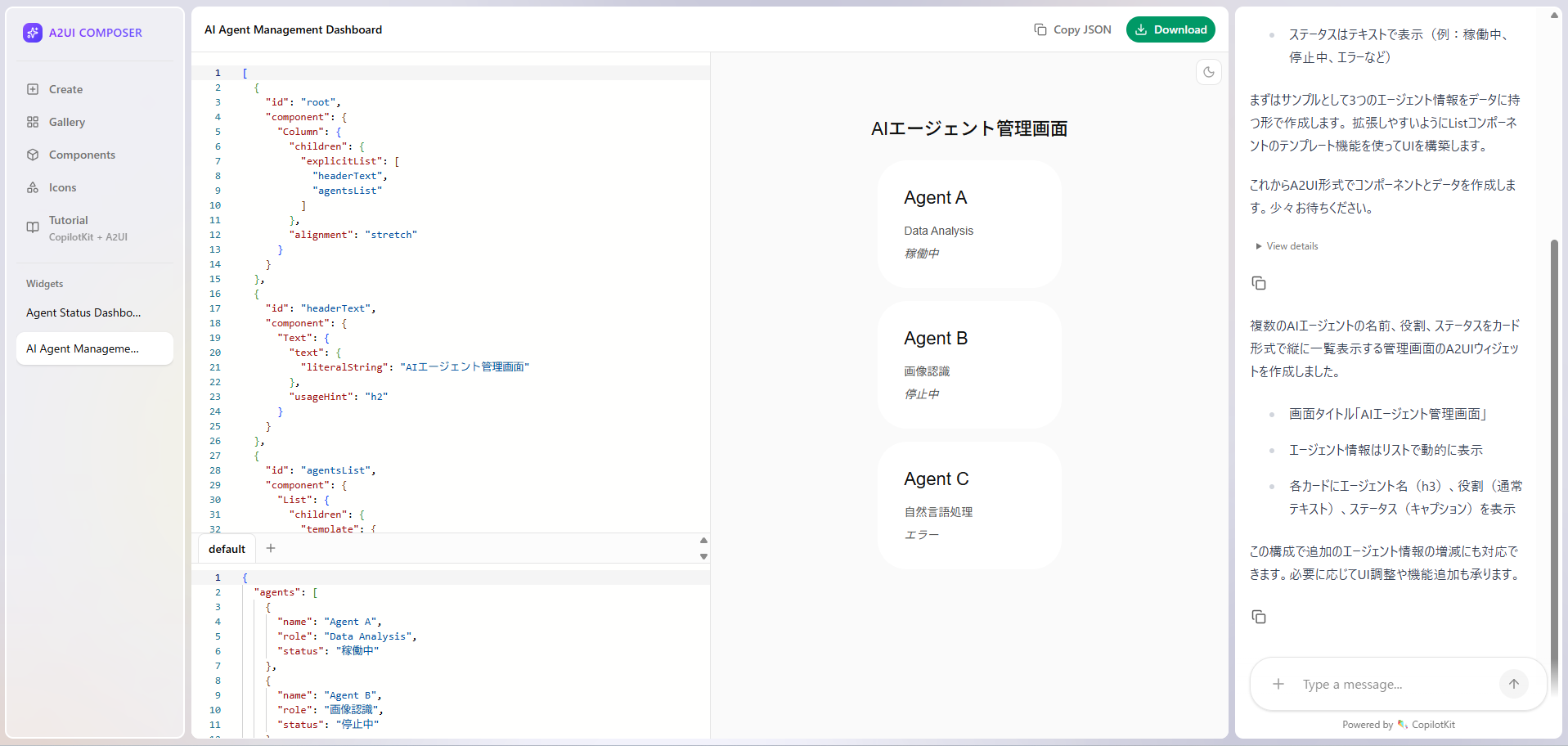

実際にA2UI Composerを使ってみた

Composerでは、「どんなUIを作りたいか」を自然な文章で入力します。

今回は次のように入力しました。

左側にAIエージェント一覧、右側に選択したエージェントの詳細(ステータス、直近のアクション、ログ)を表示するUIを作りたい

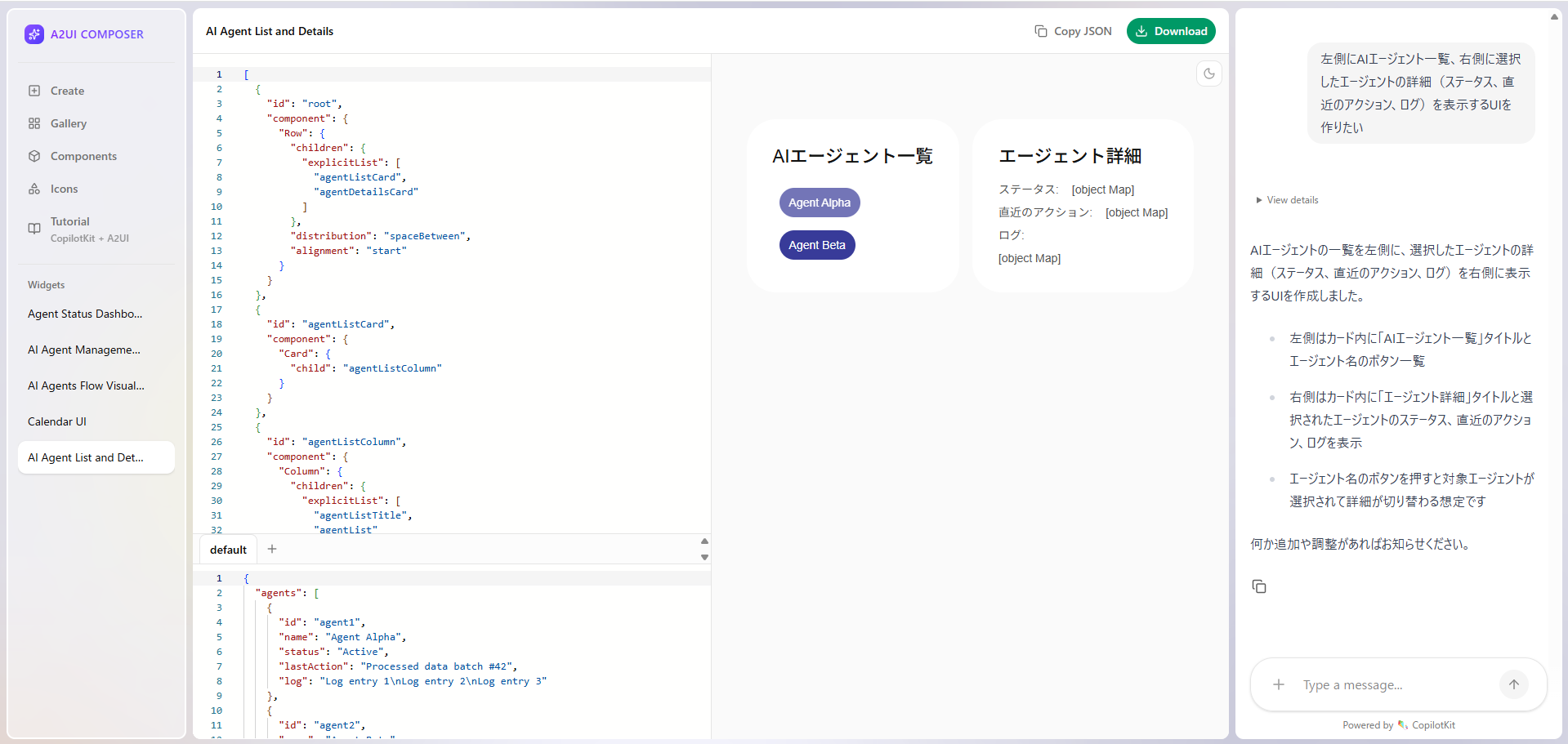

こんなのが返ってきた。

実際に生成されたUIは、次のような構成でした。

- 左側にAIエージェント一覧

- エージェント名がボタンとして表示

- 右側に選択したエージェントの詳細情報

- ステータス

- 直近のアクション

- ログ情報

「AIがUIを返す」という発想が腑に落ちる

正直、A2UIを文章だけで読んだときは

「UI標準?どう使うの?」という印象がありました。

しかしComposerを触ってみて、

- AIがJSONとしてUIを返す

- 人間側はそれを安全に描画する

- 実装とUI設計が分離できる

という思想が、一気に腑に落ちました。

A2UI が向いている人・ユースケース

A2UI は次のようなプロジェクトや人に最適です。

- AI エージェントサービスを提供・運用したい開発者

- 複数エージェントを統合する UI が必要なプロダクト

- 非エンジニアにもエージェントの動きを見せたいプロジェクト

- 客観的に UI の動きを検証したいチーム

特に プロダクトレベルの運用や企業向けサービスでは大きな効果が期待できます。

GitHub リポジトリを見る

A2UI の公式 GitHub は Google が公開しているプロジェクトです。

- README に基本仕様・目的が掲載

- 仕様ファイル(JSONL / schema)でどんな設計かが分かる

- renderer サンプルコードあり

- Apache 2.0 ライセンスで誰でも利用可能

▶ GitHub

https://github.com/google/a2ui

まとめ:AI 時代の UI インフラになる可能性

A2UI は、AI エージェントがより人間に近い形で動作を伝えるための 次世代 UI プロトコルです。

リッチ UI の生成を可能にしつつ、安全性も確保した標準仕様として、

今後 AI プロダクトに欠かせない要素になるでしょう。

次の記事では具体的な使いかたやA2UI Composer(CopilotKit)の紹介もしてます。

https://lexia-hp.com/blog/a2ui-use-cases-and-examples

ソースまとめ

- 公式サイト

https://a2ui.org/ - 公式 GitHub リポジトリ

https://github.com/google/a2ui

最後までお読みいただきありがとうございます

この記事が参考になりましたら、ぜひシェアや他の記事もご覧ください。

AIの関連記事

もっと見る →

Claude-memとは?Claudeの記憶を拡張できるオープンソースのAIツール「Claude-mem」の実際の使い方や活用事例、他AIとの比較を初心者にもわかりやすく解説します。

19分

「AIエージェントを動かしたいけれど、高価なPCやサーバーが必要なんでしょう?」そう思っていませんか。実は、たった10ドルのハードウェアと、Sipeed PicoClawという魔法のようなソフトウェアがあれば、誰でも自分だけのAIアシスタントを持てる時代が来たようです。この記事では、PicoClawの魅力と導入方法を、初心者の方にも分かりやすく、優しく解説してみようと思います。

18分

Jesse Vincent氏の「Superpowers」を使って、コーディングAIをジュニアから頼れるシニアエンジニアに進化させる方法を解説します。

13分新着記事

一覧を見る →

Supermemoryとは何かを初心者向けに整理。公式ドキュメントを参照しながら、AIが忘れる理由や記憶を補う仕組み、RAGとの違いをやさしく解説します。

5分

無料のAI音声入力アプリ「Amical(アミカル)」の基本と使い方を初心者向けに解説。Amicalとは何か、ダウンロード・インストール方法、対応デバイス、マイク設定、Whisperエンジンやオフライン利用の可否まで、この記事一つでわかります。

9分